Tipo Aquilo #44 – O computador que mudou tudo

A gente sempre ouve que, de tempos em tempos, a tecnologia dá um salto considerável em relação ao estado de arte da época. Pessoalmente, eu tenho um certo receio de usar esse termo por que esses “saltos” não se tratam de um inventor maluco num laboratório secreto; esses saltos acontecem ao juntar elementos de contextos diferentes em um único aparato, explorar lacunas sub-utilizadas de tecnologias existentes, ou dar um modo de utilidade para uma tecnologia recém-inventada. A própria tipografia, do jeito que conhecemos atualmente, é um exemplo do primeiro caso: surgiu quando Gutenberg juntou elementos da caligrafia com métodos de impressão de gravuras e a gravação de metais para criar o sistema que foi usado nos séculos seguintes.

Por esses saltos serem mais frutos de seus tempos do que intervenções divinas, nem sempre dá pra apontar algo que divide a história entre antes e depois com tanta nitidez. No domínio do design de interfaces, existe algo que faz essa divisão nítida o suficiente, que é uma das histórias mais bem e mal contadas do mundo da computação. É bem contada porque está muito bem documentada, obrigado; mas mal contada, porque envolve vários personagens que não lhe deram o devido crédito. A edição de hoje dedica-se à maquina que fez possível os computadores serem instrumento de trabalho de pessoas comuns e criou os princípios da tipografia digital, mas que injustamente nunca viu a luz do dia no mercado: o Xerox Alto.

Você deve ter ouvido esse nome en passant lá por meados de 2011, quando toda a mídia estava comovida com a morte de Steve Jobs, então CEO da Apple, ao reprisar sua história como programador, visionário de tecnologia e péssima pessoa para conviver. Então, talvez tenha pensado “como assim a Xerox fazia computadores?”. Aliás, é importante a gente começar falando sobre o que eram computadores pouco antes do Xerox Alto: se você tinha contato com aqueles mainframes mondrongos da IBM que ocupavam grandes salas, você era uma das pouquíssimas pessoas que realmente usavam computadores pra alguma coisa. Só na ficção científica que uma pessoa comum teria contato diário com qualquer coisa parecida com calculadoras mais elaboradas e do tamanho de um caixotinho.

Vamos voltar um pouco mais, no começo do começo: a essência de todo computador é fazer a passagem de energia elétrica por um circuito ser controlada para que, ora tenha energia (1), ora não tenha (0); e esse controle é feito por algo que ora conduz, ora bloqueia a energia. Esse algo é um semicondutor. Até a década de 1950, os únicos semicondutores disponíveis eram as válvulas; logo em seguida, vieram os transístores, que faziam a mesma função mas ocupavam muito menos espaço, abrindo caminho pra computadores que, ao invés de um andar inteiro (oi ENIAC), ocupavam apenas uma sala, como aquele IBM 360 da série Mad Men. Na década seguinte, foram criados os circuitos integrados, mas que a gente conhece como os chips, aquelas pecinhas pretas cheias de perninhas que condensam num bloquinho de silício dezenas de transístores.

Os chips e microchips, conforme ganhavam mais transístores internos, permitiam aos computadores serem mais rápidos. Na época, não ficaram menores porque… bem, toda empresa que pudesse comprar um computador tinha espaço de sobra para um computador. Apenas alguns engenheiros entusiastas pensavam na ideia de ter um computador pequeno em casa; ninguém pensava direito porquê uma pessoa comum ia querer uma máquina que, como eu sempre digo aqui, sabe apenas somar muito rápido. Não tinha Word, Excel, PowerPoint, Orkut, Doom, Twitter, e-mail, nada. Quem se aventurava na ideia de montar um computador pessoal — sim, montar, até 1976 não existia o computador pessoal como um produto pronto, mas sim peças avulsas —, o fazia apenas pelo desafio de aprender a programar com o que existia de BASIC… digo, de básico na computação.

(Uma pequena curiosidade, já que estamos falando de transístores… vocês devem conhecer aquela Lei de Moore, que diz que desde os anos 60 os computadores dobram de velocidade a cada 18 meses. Na verdade, o que aproximadamente dobrava a cada 18 meses era a quantidade de transístores dentro de um chip. Isso aumenta a velocidade média de processamento, mas é apenas um dos fatores.)

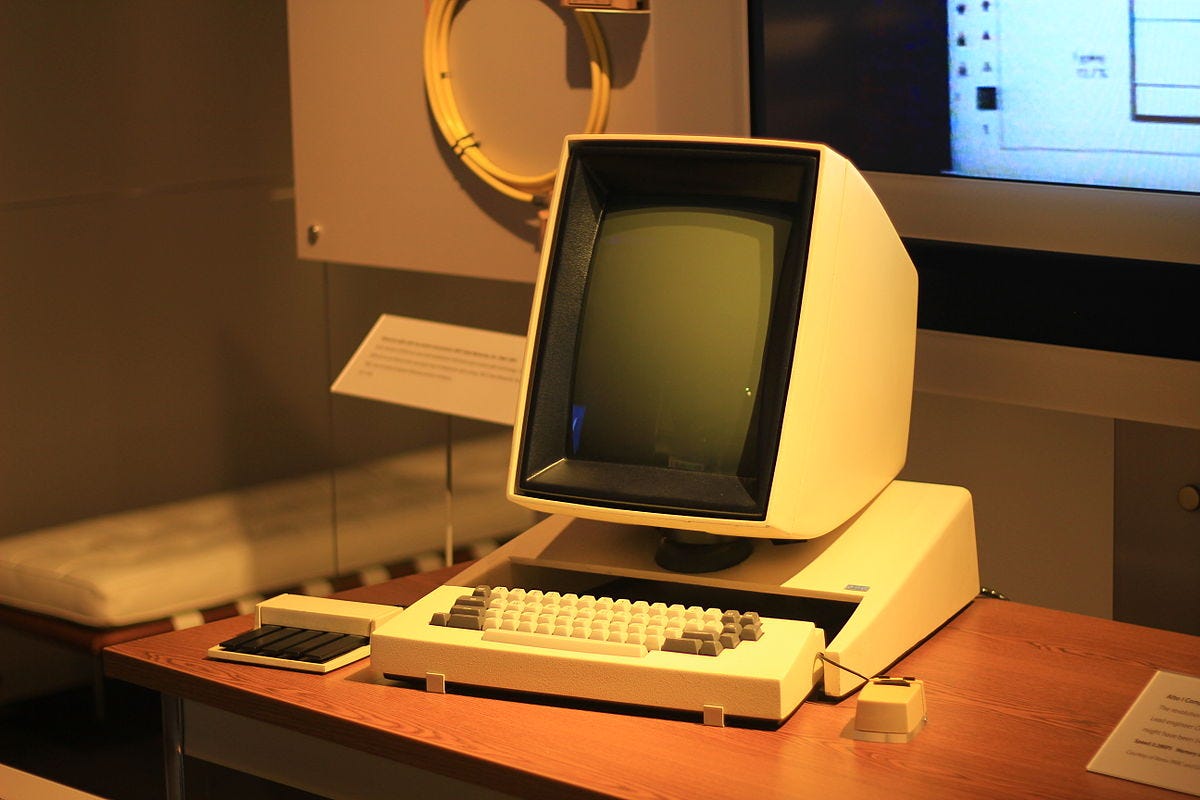

A Xerox já tinha aprendido um conceito básico de negócios: nunca depender de apenas um produto. O Xerox PARC (Palo Alto Research Center) era um centro de pesquisa de novos produtos e negócios, para algo que talvez ela quisesse entrar no ramo. O esforço de pesquisa resultou em dois conceitos que usamos basicamente todo dia. O primeiro é um protótipo de computador finalizado em 1973 que cabia num móvel de casa, mas que não era como qualquer computador: a primeira, e mais radical diferença, é que ao invés de digitar dezenas de comandos para uma tarefa, o usuário poderia fazê-la clicando num desenho análogo à tarefa — sim, estou falando de ícones. Ao invés de navegar pelos ícones com setas de teclado, o usuário poderia abri-los com gestos, usando um dispositivo que mexe um ponteiro na tela. Sim, é do mouse que estou falando.

De certa forma, a Xerox inventou o primeiro computador pessoal. Ou microcomputador, se você já foi vacinado. Com esses recursos, ele não dependia do usuário ser versado em programação, pois a máquina oferecia um modo de uso intuitivo o suficiente para o usuário aprender sozinho. O grande problema é que ainda não existia grandes utilidades para um computador na casa de alguém, por isso o protótipo nunca deu origem a um modelo comercial. Caso fosse, cada máquina custaria 32 mil dólares — em valores atuais, mais de 110 mil bidens (vai, reclama da Apple agora). Por isso, ao invés de uma legião de fãs, a máquina ganhou apenas o nome da cidade em que foi desenvolvido: Alto.

Só que esse conceito de interface com desenhos e setinha, que hoje é chamada de GUI (interface gráfica de usuário), era boa demais pra ficar perdida num laboratório. Os computadores pessoais, mesmo rudimentares, estavam surgindo no mercado. O Apple II, lançado em 1977, já despontava como um sucesso, tendo uma comunidade de programadores fazendo coisas realmente úteis para uma pessoa ter um computador em casa, como planilhas básicas, edição de texto e joguinhos. Agora sim eu falo de um computador inteiro, um caixote branco de plástico com tudo que a pessoa precisa. Ainda era coisa de entusiasta, dependia de saber rodar comandos de texto, mas Jobs e Steve Wozniak queriam mudar isso. Foi após uma visita ao Xerox PARC em 1979 que Jobs viu o conceito de GUI. Foi amor à primeira vista.

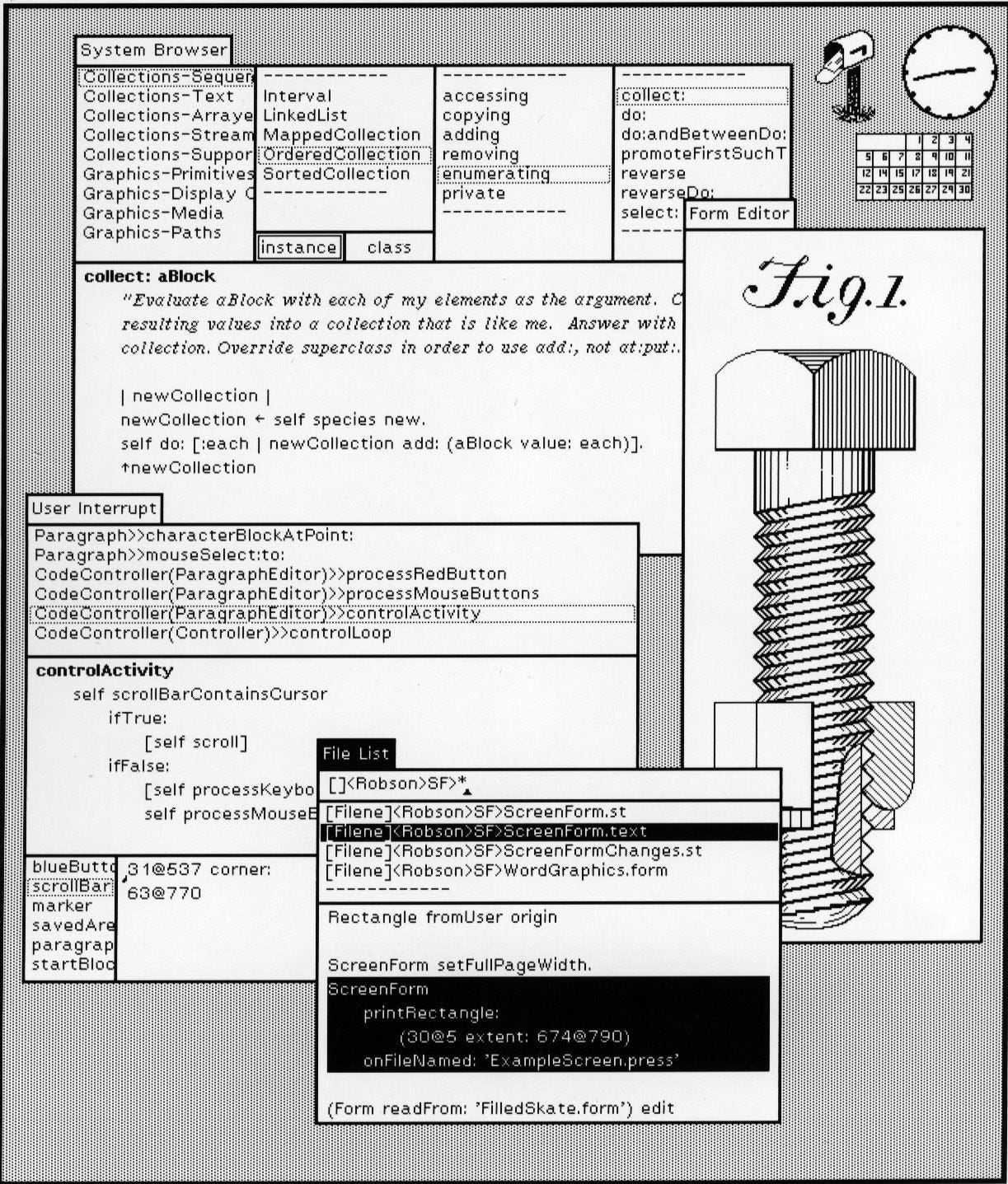

Não bastassem os ícones e o uso do sistema com teclado e mouse, ele também se encantou com as letras. Antes do Alto, as letras de um sistema eram simples mapas de pixels pintados um por um. Quando o computador precisava da letra “a”, ele consultava uma fonte que dizia que a letra “a” tinha certos pixels iluminados e outros apagados, e só. Se você precisasse dessa letra “a” maior, precisaria de outra fonte para isso, não existia outro meio do computador saber a forma da letra “a”. No Alto, além de fontes com mapas de pixels, ele utilizava fontes que continham os contorno das letras; elas diziam ao sistema qual era a forma da letra “a”, e o sistema dava seu jeito de pintar os pixels baseados nesse contorno, escalando o desenho da letra de acordo com o tamanho que a tela precisava.

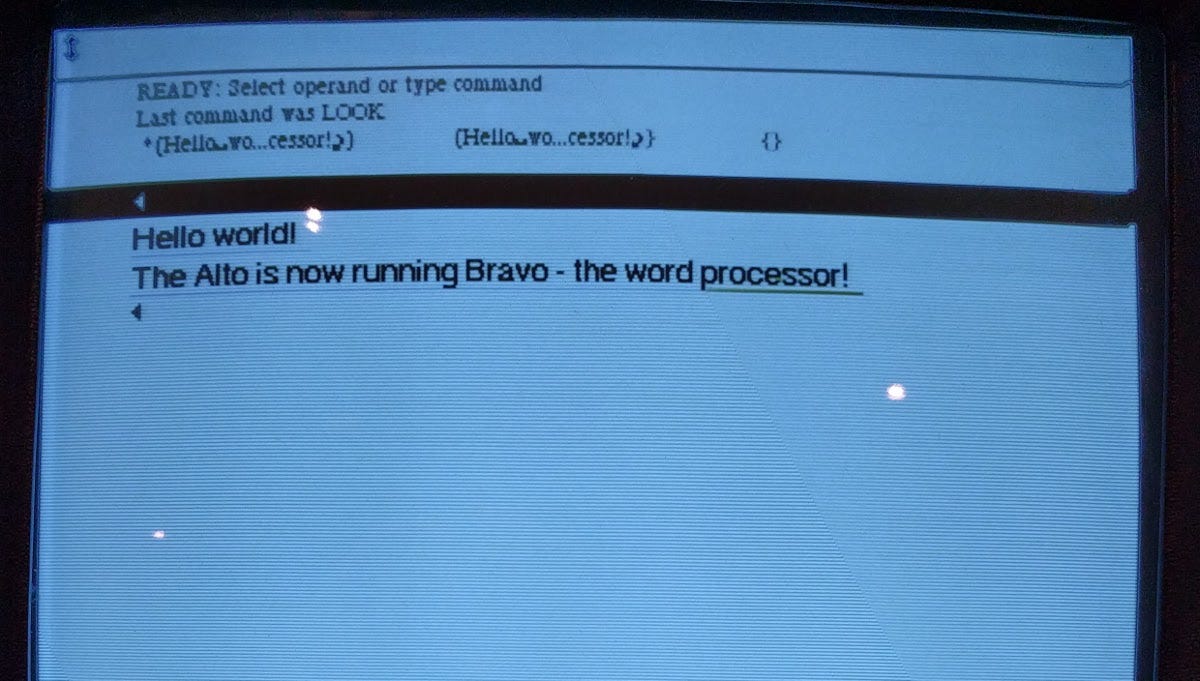

Isso parece bobo, mas tipografia digital funciona mais ou menos desse jeito até hoje; tanto que esse sistema é um ancestral do formato TrueType, comum no Windows e no Mac. Calcada nessa tecnologia de reproduzir letras, a Xerox criou o primeiro editor de texto WYSIWYG — What You See Is What You Get. Em resumo, num programa WYSIWYG, o seu resultado final era o que você via na tela. Num editor de texto, por exemplo, o que saía da impressora era uma folha com letras e números do jeito que estavam na tela do computador. Isso é essencial para o surgimento do desktop publishing, que permitiu que documentos, pequenos impressos e, com o tempo, até revistas e jornais inteiros fossem produzidos em computadores, aposentando a fotocomposição e linotipo na indústria editorial e abrindo espaço para Aldus PageMaker, Quark e outros aplicativos.

O Alto tinha toda essa tecnologia, mas nunca foi posto à venda. As quase duzentas unidades produzidas foram distribuídas entre os escritórios da Xerox e serviram de base para o Xerox Star, de 1981. Enfim a Xerox tentou a sorte no mercado de computadores pessoais, mas não conseguiu competir com o sucesso do Apple II, mais popular e barato (quem diria, hein?!). Só que a visita de Steve Jobs e o time da Apple ao Xerox PARC é uma história quase sempre contada pelas metades, como se Jobs tivesse pulado a cerca e “roubado como artista” a interface gráfica do Alto. Essa visita fazia parte de uma iniciativa da própria Xerox de investir na Apple e permitir que os dois conceitos geniais que a Xerox fez no PARC encontrassem o mercado. Logo, aquela história de que a tipografia no Mac era avançada por causa das aulas de caligrafia que o Jobs tomou durante um sabático dele não é tão verdade assim… assim como quase tudo que o Jobs dizia sobre si mesmo.

(parte dessa visita foi dramatizada no filme "Pirates of Silicon Valley", de 1999; ajuda a entender um pouco o contexto da época, mas não tome a história do filme como um registro fiel de como tudo aconteceu… e também não espere uma obra-prima)

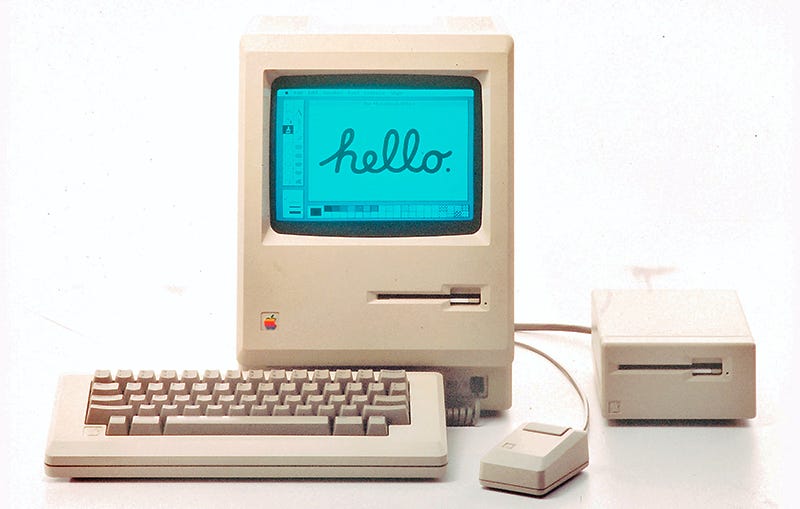

O time de piratas da Apple aprendeu tudo que pôde no PARC e, em 1984, lançou o Macintosh. Enfim, o público pôde comprar um computador acessível com uma interface gráfica que uma pessoa comum aprendia a usar em muito menos tempo. O resto é história: Bill Gates viu o Macintosh, pegou o que gostou, criou o Windows 3, e logo vieram anos de batalha judicial e magistrados tentando entender o que diabos significava a Apple querer direitos autorais sobre o look and feel do Mac. Várias invenções modernas são, de certa forma, invenções sem inventores: nasceram de ideias que estavam no ar e algum esperto pegou e juntou tudo como pôde. Se você quiser muito dar crédito a alguém: o nome do indivíduo é Robert Taylor, diretor do PARC de 1970 a 1983, que coordenou os times que produziram tecnologias que mudaram o mundo pra sempre.

Mas Cadu, você falou que a Xerox criou dois conceitos que a gente usa até hoje. Qual é o segundo?

Ah, é uma coisa boba chamada rede de computadores. Aposto que ninguém usa. ;)

Recomendações:

🎧 Podcast: Primeiro Contato #1, que conta a história do atraso da chegada dos computadores ao Brasil e como eles finalmente apareceram no país durante as décadas de 1980 e 1990.

🎥 Vídeo: Xerox Parc - Office Alto Commercial [em inglês], um anúncio interno do Xerox Alto e alguns de seus recursos da época.

🔗 Link: ContrAltoJS, um emulador do sistema operacional do Xerox Alto que roda no navegador usando Javascript.

🇧🇷 Fonte brazuca: Tomorrow, de Monica Rizzolli e Tony de Marco.

Nota do editor:

Dois assuntos importantes, e o primeiro deles é rápido: este que vos escreve finalmente tomou sua primeira dose da vacina, sem efeitos colaterais e no aguardo da próxima agulhada de Coronavac daqui a um mês. Como eu tenho estudado quase todo dia, voltado ao trabalho e fazendo um monte de coisas, só agora tem caído a ficha do alívio que significa que pegar Covid não é mais uma roleta com 0,7% de chance de morrer. Talvez mais, por causa das variantes. Por isso, mesmo depois da segunda dose, os cuidados por aqui não vão acabar, e espero que não acabem com você, quando chegar ou se já tiver chegado sua vez. Vacinação é um grande passo, mas não o único para o fim da pandemia.

Segundo, e aproveitando que hoje o papo é de tecnologia: você deve ter ouvido falar das quadrilhas limpa-contas que causaram pânico entre as pessoas porque, segundo elas, a promessa era de que qualquer criminoso poderia desbloquear qualquer telefone, conseguir acesso ao banco e pegar todo o dinheiro da conta da pessoa.

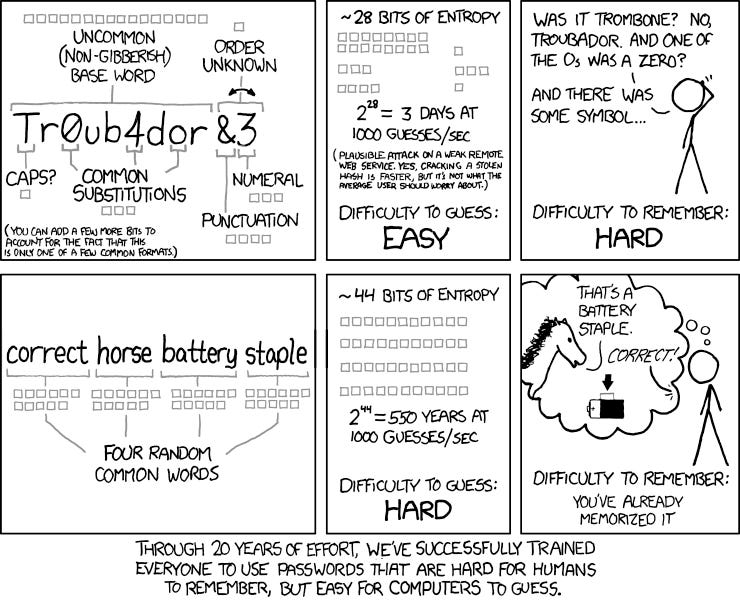

Quando ouvi sobre esse caso, minha reação inicialmente foi bem cética; dezenas de forças policiais penam pra desbloquear telefones de criminosos todo dia, então não acho que um ladrão de esquina teria poder pra isso. Só que, ao analisar detalhes do caso, algumas fichas caíram e, pra que caíssem, dependiam de entender falhas comuns que as pessoas têm com suas senhas e credenciais.

Eu sou chato com isso e gosto de incentivar as pessoas a serem precavidas também. Hoje em dia, o esforço de produzir senhas melhores e guarda-las em lugares seguros é pouco e compensa muito. Vale a pena usar bancos de senhas como o Bitwarden, LastPass ou 1Password, em que você pode criar senhas difíceis de quebrar com ataques simples e guarda-las num lugar seguro e criptografado.

Além disso, os serviços mais comuns, como os apps de Google e Apple, Facebook, Twitter, GitHub, Discord, Skype, Office 365 etc oferecem um recurso chamado 2FA ou MFA, que usa como credenciais seu nome de usuário, senha e uma senha temporária que muda a cada 30 segundos, como um token de banco. Ative em todos que você tiver conta e use um aplicativo como o Authy para gerenciar as senhas temporárias. Evite ao máximo usar o seu número de celular para autenticação em dois passos, pois um dos elementos do golpe dos limpa-contas é apossar-se do chip de telefone para receber códigos de autenticação em outro celular.

Por fim: se você precisa anotar alguma senha ou informação importante, salve em algum dos aplicativos que eu mencionei antes, pois o conteúdo deles é criptografado. Tem aquelas dicas de sempre, de nunca usar senha repetida, misturar números com letras e caracteres especiais… enfim, existem formas de se proteger.

Escrito em 99153.32